sqoop核心功能与使用场景拓展

Sqoop 作为 Hadoop 生态中连接关系型数据库与分布式存储的重要工具,除了基础的数据导入导出功能外,还有许多实用特性和最佳实践值得关注。

核心功能详解

数据导入(Import)

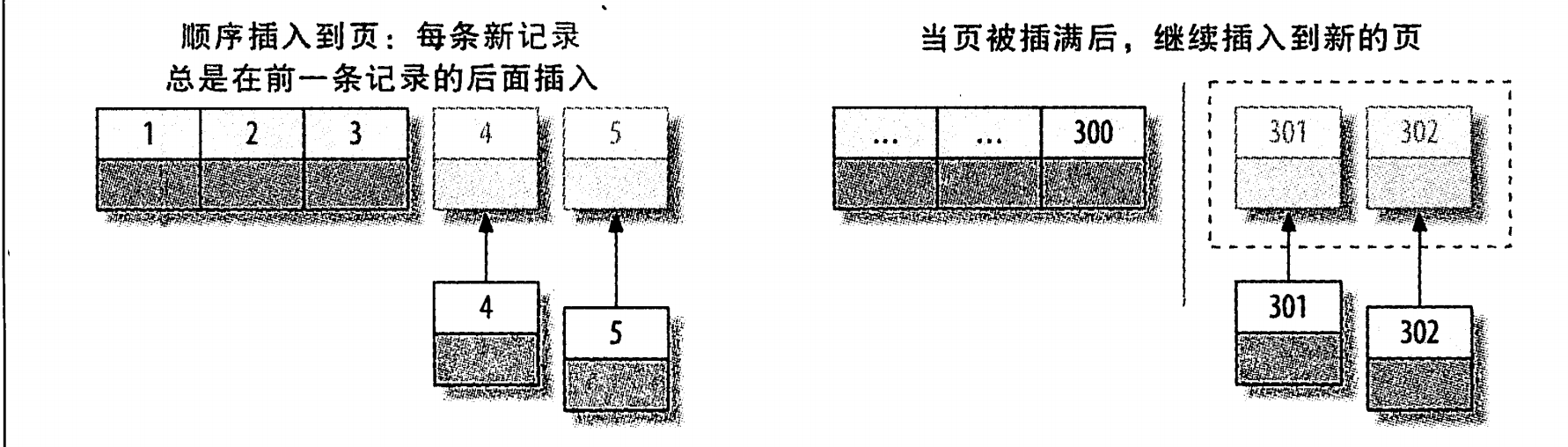

全量导入:将关系型数据库中的整张表数据一次性导入到 HDFS、Hive 或 HBase 中。

1

2

3

4

5

6

7sqoop import \

--connect jdbc:mysql://localhost:3306/testdb \

--username root \

--password 123456 \

--table user_info \

--target-dir /user/hadoop/user_info \

--m 1增量导入:针对数据的新增或变化部分进行导入,避免重复处理历史数据。

- 基于递增列(append 模式)

- 基于时间戳(lastmodified 模式)

数据导出(Export)

将 HDFS 或 Hive 中的数据写入到关系型数据库中,需要目标表提前存在。

1 | sqoop export \ |

关键组件与工作机制

| 组件 | 作用 |

|---|---|

| Sqoop Metastore | 存储导入导出作业的元数据,支持作业的重复执行和增量更新 |

| 代码生成器 | 自动生成与数据库表结构对应的 Java 类(POJO),用于数据序列化 / 反序列化 |

| MapReduce 作业 | 实际执行数据传输的载体,仅使用 Map 任务(无 Reduce 任务),通过并行处理提高效率 |