spark入门实战:WordCount 程序全解析

WordCount(单词计数)是大数据领域的 “Hello World”,通过它可以快速理解 Spark 的核心概念和编程模型。本文以 Scala 为例,从环境准备、代码实现到执行原理,全方位讲解 Spark WordCount 程序,帮助初学者入门 Spark 分布式计算。

环境准备:版本匹配与依赖配置

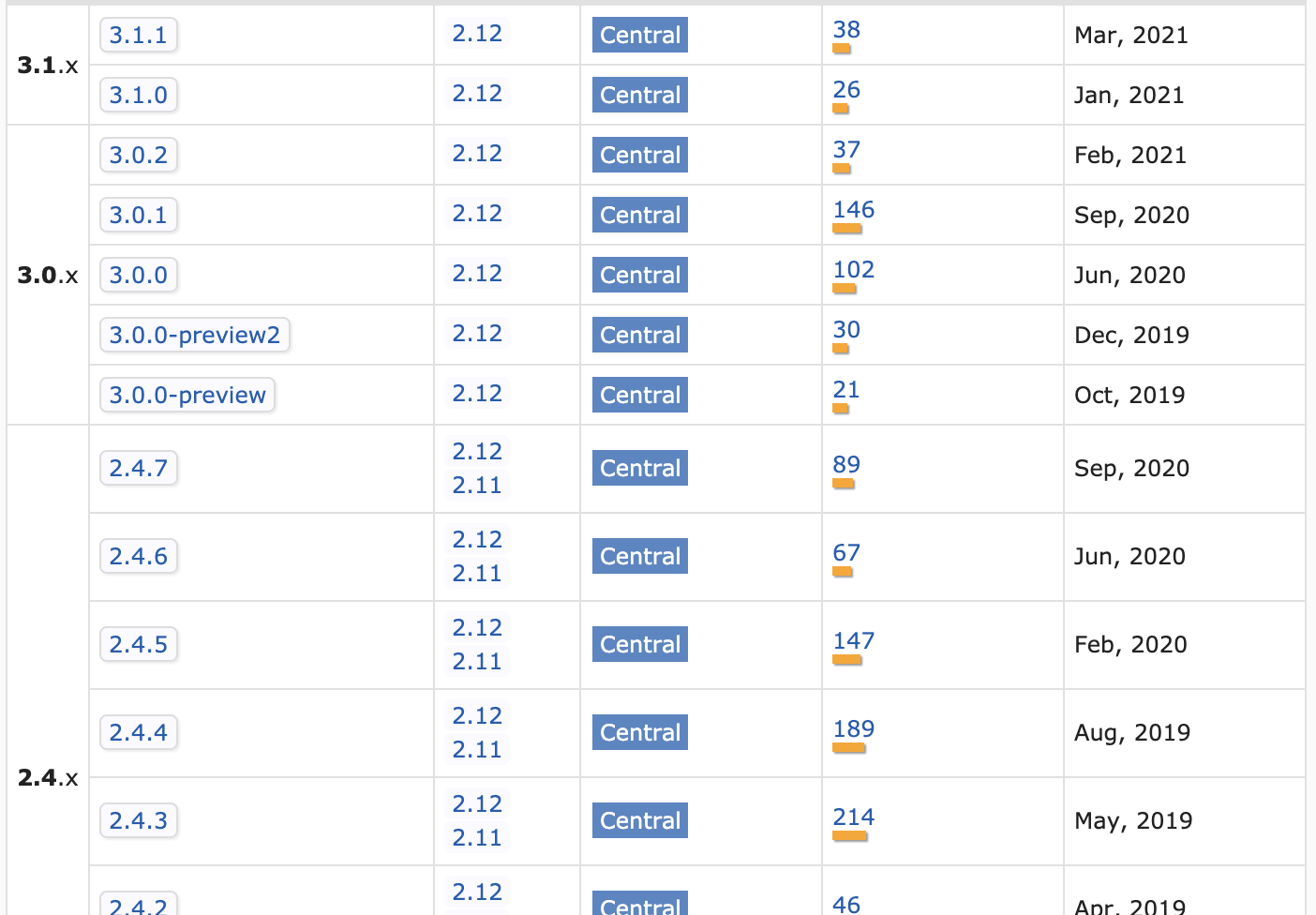

Spark 对 Scala 版本有严格依赖,错误的版本组合会导致兼容性问题(如类找不到、方法异常),需提前确认版本对应关系。

版本选择原则

- Spark 2.x 主要支持 Scala 2.11、2.12;

- Spark 3.x 主要支持 Scala 2.12、2.13(但部分早期 3.x 版本对 2.13 支持不完善);

- 推荐组合:Spark 3.1.1 + Scala 2.12.x(稳定性好,生态支持完善)。

Maven 依赖配置

在 pom.xml 中添加 Spark Core 和 Scala 依赖:

1 | <!-- Scala 核心库 --> |

注意:

spark-coreartifactId 中的_2.12必须与 Scala 版本一致,否则会出现ClassNotFoundException。

WordCount 核心代码实现

WordCount 的核心逻辑是 “读取文本 → 拆分单词 → 计数聚合”,Spark 通过 RDD 算子实现分布式计算。